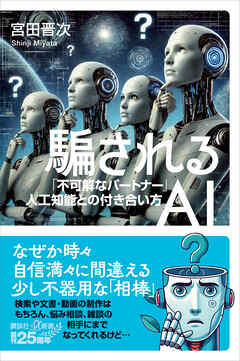

あらすじ

AIは地図を読むことが人間より苦手だという。

画像を読み解くことも、指示を読みとることも大得意なのに、人間のように画像と指示記号を組み合わせ、現場の状況にあわせて判断することが苦手なのだ。

実はAIには、ほかにも苦手なことはたくさんある。

長々と説明されると質問に対する警戒心が下がり、本来回答してはいけないことを回答してしまう。

顧客対応にあたったAIが、信じられないほどの安値で最新型の車を販売することに同意してしまったこともある。

ときにAIは哲学者のような深淵を感じさせる回答をすることもあるが、それはAIが「深く考えている」からではない。過去に人間が行ってきた無数の問答をかき集め、その中からもっとも適切と思われるものを選択して、それを組み合わせて「それっぽく」見せているだけなのだ。

AIはあらゆるデータベースにアクセスして選択するというプロセスを経る。つまり、AIはきわめて「信じやすい」という特徴を持つ。逆に言えば、AIはきわめて「騙されやすい」のだ。

人間のように、この人、どうも怪しいなとか、いまひとつ信用できない、という警戒心は薄い。

近い将来、AIエージェントが旅行の日程を考え、飛行機や列車、ホテルの予約をとり、行くべきところ、見るべきところを案内してくれるような時代が来る。

しかしそのAIエージェントが誰かに乗っ取られていたり、騙されていたら――その旅行は目も当てらない悲惨なものになるかもしれない。

AIはなぜ騙されるのか。どんな弱点があるのか。

AIとの共生が当たり前の社会になりつつあるいま、必読の一冊。

自らサイバーセキュリティの会社を率いる著者が教える、「AIという人格」のリアル。

感情タグBEST3

Posted by ブクログ

ハルシネーション

もっともらしく嘘を流す

AIを使うと考える力が弱くなる

大して考えられない人間が使うからそうなる

AIはパートナーとして使う

思考の深掘りに使う

批判してもらう

自分の能力を拡張できる

Posted by ブクログ

リアル本にて。

コーチャンフォー若葉台店にて購入。

脆弱性診断を生業とする著者が、生成AIのリスクを多角的に紹介しており、とても勉強になった。

生成AIのリスク・つきあい方において重要なのは、自然言語コミュニケーションに対する柔軟な想像力と、特定の何かだけで安易に対策完了とすべきではない(原理的にできない)ことを念頭におくことだと、本書を通じて考えた。LLMは自然言語を介して処理を行う。そのため、そのリスク・つきあい方は、自ずとソーシャルエンジニアリングや詐欺のそれに近いものになる。

一つ一つのトピックは数ページにまとめられていて軽く読める一方で、そのトピックのベースとした論文のQRコードが記載されていて、リアル本であっても簡単に原典にあたれるように配慮されていることにも、好感がもてた。

Posted by ブクログ

アプリや業務システムの脆弱性診断の仕事をしている人が書いた本。

AIが通常では回答しないようにプログラムされていること(爆弾の作り方など)に対して、悪意を持って、意図的な質問を投げかけるなどして操作することで、AIは騙されて回答してしまうことがあるなど、AIの脆弱性について書かれている本。