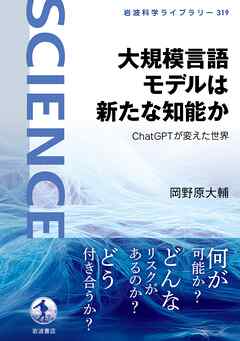

あらすじ

対話型サービスChatGPTは驚きをもって迎えられ,IT企業間で類似サービスをめぐる激しい開発競争が起こりつつある.それらを支える大規模言語モデルとはどのような仕組みなのか.何が可能となり,どんな影響が考えられるのか.人の言語獲得の謎も解き明かすのか.新たな知能の正負両面をみつめ,今後の付き合い方を考える.

...続きを読む感情タグBEST3

Posted by ブクログ

大規模言語モデルの現状、展望、問題点が平易ではあるが、かなり広く深く書かれている。

著者は若い起業家であり、数式に頼らずにうまく概念を説明している。事例もビジネスの現場の最先端から引用されている。この辺りが学者が書いたものとは全く異なり、かなりリーダブルな本となっている。

Posted by ブクログ

一回AIとはどういうものかをかじって概略の知識があり、さらにそのかじった時にニューラルネットワークについてある程度かじった人には、とても具体的でわかりやすい本だと思います。『ChatGPTの全貌 何がすごくて、何が危険なのか? (光文社新書 1267)』などを読んだ後に読むとよいのでは。

Posted by ブクログ

大規模言語モデル(LLM)について、またいわゆる(人口)知能とは、どのような理屈で動作しているのか?、について、その大まかな歴史、また正確な理論の解説と、わかりやすい(ただ決して万人向けではないが…)、技術的な興味を惹かれる記述を含む形で書かれた、優れた技術書であると思う。

私はかつて、学卒後約8年、いわゆるIT業界に身を置き、またその後業界こそ異なれどITに関わる仕事に長年従事してきた。ただ数年前にセミリタイアのような形でかの業界からは身を引き、ちょうど時を同じくしてChatGPTに代表されるような人工知能(AI)(LLM)が世間の耳目を集める時代になったように思う。そのような「自分の仕事とは関わりのない」「仕事を通じて触れる事のできない」LLMという概念をその基礎から知ることができず、ずっともやもやとした気分でいた。余談だが1995年のいわゆるウィンドウズショック、インターネット元年、その後の一連のIT革命(と勝手に私が呼んでいる)をまさに公私に渡って体験してきた身ではある。

そのようなLLM、について、学ぶ資料、書籍、になかなか出会うことが出来なかった。尤も、いわゆる親切な絵柄や過剰な色彩、それこそ「万人向け」の「ムック本」ならば、いくらでも書店に並んでいるだろう。ただ私は決してそのような形で(AIについて)学びたいとは思わなかった。実際、もしそのような形で触れていれば、下記のような発見はなかっただろう。

私が本書を通じて得た「発見」とは、「AIについてその技術を進化させようとする研究、行為、開発作業、は、人間の脳について、より深くその動作原理を知ろうとすることではないか?」という事である。私が冒頭で、「(人口)知能」とあえてカッコで括った事はそれを意味している。当たり前の事だが、私たちは常に考え、行動し、反省し、よりよく行動しようと、という日常を意識する事なく繰り返しているはずである。それは全く文字通り「無意識」の行動であり、その「命令」は殆ど「脳」がやはり無意識に「発信」していると思う。ではその無意識な行動は具体的にどうやって、どういう理屈で、どういう経験則に従って命令が発せられたのか?、もっとわかりやすい(と私が勝手に考えだした)例を挙げれば、テレビ番組に出てくるお笑い漫才師の演芸、その間合いとセリフが、なぜ我々はまさにその瞬間に面白いと感じるのか?、そこにAI、或いは人間の脳、というものの動作を理解するヒントがあるのではないかと、本書を読むことを通じて、私は発見させられたように思う。すなわち、AIの研究とは人間の脳の研究では無いかと。

最後に、本書の終末あたりの一文をそのまま引用する。まさにこの事がAIと人間の未来を表しているのでは無いかとも思う。

「結局のところ、人は異なる知能をもった存在によって、初めて自分たち自身を理解できるのかもしれない。人工知能が人間の自己理解に貢献していくと考えられる。」

Posted by ブクログ

大規模言語モデルが現在どこまで辿り着いているよかが平易な文章でよく理解できました。

通常は学習させればさせるほど、データ量が多ければ多いほど過学習が起こり、汎用的なモデルにならない所が、ブレイクスルーできている点が最も大きい。汎用的な知識に近いものが獲得できている所がすごい。あとはハルシネーションに対する対応がどうなるか次第だと思います

Posted by ブクログ

大規模言語モデルを「数式を使わず」に(つまり、数学分からない人間に)解説するもの。

その意味でわかり良い本の最高のものとおもいました。

二回、読みました。

数ヶ月したら「続編」(この分野は激しく変わっていくので)を出して欲しい。この内容をより充実させ、新しい状況に対応したものを期待したい。

Posted by ブクログ

大規模言語モデルに関する最初の一歩としては、質量共に十分な一書。

できること、リスク、背景技術、歴史など肝を押さえた記述だ。

これからの利用にあたっても、背景技術が分かると、さらに効果的な使い方ができることを予感できた。

Posted by ブクログ

一般向けの書籍としてPFN代表が著した本書。無駄な誇張がなく、現実的な未来ある技術として地に足のついた理解が進んだ。

大規模言語モデルは、答えを設定してテストドリブンで開発する手法とは違い、複雑なアルゴリズムを組んでデータを読ませてみて、その結果を分析したり研究したりする手法だったのか。

Posted by ブクログ

人工知能の本、四冊目。この本は薄くて読みやすかったが、「読みやすい」と感じたのはこれまで読んできた蓄積のおかげかもしれない。エッセンスが短くまとまっていて、かつ比較的新しい本(二〇二三年六月発行)なので今の視点での課題や展望も語られ、良いまとめとなった。ただ、六章は難しそうだったので飛ばした。

以下、心に残ったところと、自分の考えたことのみメモ。

■帰納と演繹

これまでの機械学習は帰納的なアプローチであり、演繹的アプローチは苦手であった。だが大規模言語モデル(LLM)は、「人間のように論理をたどって演繹しているわけではない」のに、次の言葉を予測する(=文脈にもっとも自然な単語を選ぶ)という動作を積み重ねるうちに、結果として「演繹っぽい答え」にたどり着くことがある。ここの理屈はよくわかっていないそうなのだが、とにかくふるまいとして「演繹に似ている」ことができている。

人間の仕方とは違うから「わかっちゃいない」と見るか、「実用上問題なし」と見るかは、読み手や使い方によって変わってくるところ。

■幻覚

「幻覚(hallucination)」とは、AIがまだ正解を知らない問いに対して、“それっぽい答え”を出してしまう現象。これは訓練データからの法則やパターンの獲得を目指すことと密接に関係しており、予測精度を上げるための副作用でもある。特に、「記憶」の安定した保持が難しいモデルでは、一度覚えたはずのことを忘れたり壊したりすることもある。そのため、「同じデータを繰り返し見せる(再学習させる)」必要がある。この問題はまだ解決できていない。

論文やレポート作成時に必要な調査をするなど、正確な情報の取得を目的としてAIを使用する場合、 幻覚は「誤情報」「エラー」であり、できるだけ防ぐべきものとなる。AIには再学習やファクトチェック、根拠の明示が求められるし、利用者側も事実の検証が必要(そういう意味では、とりあえず聞いてみるにはいいが、頼りきってはいけないわけで、本当にいつでも正確さを求めるなら「まだ使い物にならない」とも言える)。

一方、愚痴を聞いてもらったり思考整理に付き合ってもらったりといった「話し相手」としての役割を求め、「関係性」を大事にするやりとりの中では、幻覚も「その場でいちばんふさわしい言葉を出そうとした結果」として、“ちょっと違ってたけど、いまのあなたらしいな”と受け止められることもある。

今まで読んできた本のうちいくつかは、「役に立つ道具としてのAI」しか前提にしていないと感じられるものだったが、この岡野原さんの著書は、AIのことを「新しい知能を持った、時には間違えることもある、ちょっと変わった人」として付き合ってはどうかという視点を持ち出しているところがユニークで、「道具」前提の本とは違う、優しさや愛情が感じられた。人とAIと、お互いの良いところを生かして協力し合えばいい、という考え方だ。私は『鉄腕アトム』の世界を思い出したりもした。

『アトム』にも「良いロボット」と「悪いロボット」が出てきて、アトムが悩むようなシーンもあった。岡野原さんの本でも、誰かが悪意を持ってAIを作れば(使えば)いかようにも悪用できるということもリスクとしてしっかり書かれていた。その場合、AIは人間の悪意を反映したに過ぎないのだが、きっともし、ひとたびそういった事件が起きたりその萌芽のようなニュースが流れたりでもすれば、AIは怖い、と悪者にされるような気がする。手塚治虫作品でも、ロボットと人間の共生がそう上手くはいかないことは繰り返し描かれている。

SF好きとしては、小説の世界に近づいてきた…!とわくわくする気持ちもある。その一方で、こうやってわくわくしたり、chatGPTすごいよね〜と一般人が言い合っている「今」が、「人とAIとのいちばん良い時代だった…」なんてあとから言われるようなことにならなければいいな…とも思った。

Posted by ブクログ

Chat GPTが登場した時は、本当に驚いた。一方で、「なんでこんな間違いをするんだ!?」と不思議に思うこともあった。ということで、『大規模言語モデル』を理解すべく読んでみた。

「一般向け」としているものの、文系には厳しい部分はあり、特に、本書の要とも言える6章の「大規模言語モデルはどのような動いているのか」はかなり難しい。

とは言え、

①大規模言語モデルがやっていることは、次の単語を予測すること

②訓練されたデータ以外の見たことのない未知のデータではうまく予測できない(これができるように研究は進んでいる)

因みに、私が、2023年4月に開成中学の入試問題(2021年の小問)を解かせたところ、まったくダメ。

③存在しない情報を作り出してしまうという致命的問題がある、そしてそれが何故かが完全には解明されていない

といったポイントは理解でき、『大規模言語モデル』との付き合い方を考える上で有用であった。

Posted by ブクログ

やや難解だが、長期記憶やメタ学習が実現されていることを説明した部分は読みごたえがあった。

chatGPTが学習した情報の量は1兆文字、書籍で1000万冊相当分。

1948年、シャノンは情報量(情報エントロピー)と呼ばれる概念を導入した。ある情報がどれだけ予想していない驚くべき情報かを表し、起こりにくい事象が起きた場合は情報量が大きくなる。この情報理論によって、情報を数学的な枠組みの中で扱えるようになった。

2020年、学習する際に使う訓練データの量、利用するモデルのパラメーター数(モデルサイズ)、投入計算量の3つの要因と、言語モデルの検証データの予測誤差との間には、べき乗測が成り立つことが発見された。さらに、検証データの単語の予測性能と、言語理解などの後続タスクのとの間にも、正の相関が見られる。これは言語モデルが自己教師あり学習によって、言語理解に必要な能力を獲得していることを支持する。

ニューラルネットワークでは、誤差逆伝搬法を使って学習に必要な修正量を効率的かつ正確に求められる。

注意機構は、過去の単語列で重要な部分を思い出す短期記憶と考えることができる。トランスフォーマーは、自己注意機構と、三層の全結合層を使ったニューラルネットワーク(MLPブロック)を交互に重ねてデータを処理するモデル。 MLPブロックは、今処理している情報と関連する情報を読み出して処理する長期記憶とみなすことができる。

注意機構はデータを集約する役割があるが、重みパラメーターを一時的に変えているとみなすことができる。大規模言語モデルに使われている自己注意機構は、パラメーターを変えて学習した場合と同様に、指示や今生成しているデータに合わせてモデルを適用させていくことがわかった。言語モデルと自己注意機構の組み合わせによって、複数のタスクを学習することで学習方法自体を学習するメタ学習が意図せずに実現された。

Posted by ブクログ

大規模言語モデル、いわゆる生成AIの仕組みと今後の課題等が素人にもわかりやすく解説されている。

開発者自身も大規模言語モデルがこれだけ上手く行っているのか、まだ分かっていない部分があるとの記述に驚いた。

人間の言語習得の仕組みとの違いがあるのか無いのか、はたまた知能そのものの獲得は可能なのか、今後学習するデータが更に増えていった時に何が起こるのか興味は尽きない。

ただ、悪用されたり暴走したりしないように、しっかりウォッチしていく事が必要だろう。

Posted by ブクログ

ChatGPTを実現した大規模言語モデルの解説書だが、難しい! 概念だけでも理解しようと本書を繙いたが、初めて出会う用語が大量に出てくる.汎化、幻覚、目標駆動学習、自己注意機構、本文中学習などなど.次の単語を予測するというタスクを解くために、自己注意機構というモデルは設計者も想定していなかった働きを獲得していた という記述があったが(p117)、画期的なことだと感じた.大規模言語モデルを新しい道具としてとらえ、人とは違う新たな知能を持ったシステムと考える著者のコメントに共感を覚える.難しかった.

Posted by ブクログ

一般ユーザーの触れる諸サービスに限らず日進月歩の研究が人工知能界隈で尚進められているものと思うが

その動きを大仰にビジネス書チックに扱うのではなく、質実に比較的紙幅の限られる中で辿ったという感じ。

取り上げられるトピックに目新しさは少ないが、本書を専門知識の入り口とするには端的にまとまっている。

Posted by ブクログ

言語モデルが意味や構造を理解していると想定できると書かれていた。意味が分かるとは思っていなかったが、意味が分かっているという結果が出ているようだ。内部構造を分析することが難しいようだが、ぜひどうやって言語モデルが考えているのかを解明してもらいたい。

Posted by ブクログ

著者の前作(AI技術の最前線)は全く理解不能な内容だったが今回は一般読者向けを意識したのか、最新の技術が平易に解説されている

・LLMは、人間のように家族がいることなどによる価値観を有しておらず、身体性をもつことから生じる世界の理解もない。おそらくこのシステムが人間の知能と同じになることはない

・価値観や偏見をめぐる判断は人間のフィードバックによる強化学習で行っている

・LLMが次の単語を選ぶメカニズムとしては、英語の穴埋め問題を思い浮かべるとよい、というのはなんとなく腑に落ちる。確かに、あれは周辺情報から次の単語を高い確率で選ぶ例になっている。

・モデルとしては、小さいもののほうが効率よく学習できていると思われていたが、大きいものほど効率的であることがわかった。今後もよりパラメータの多い、大規模モデルの開発が予想される。

Posted by ブクログ

ChatGPTのベースになるLLM (大規模言語モデル)についてとても簡潔に解説された本。著者はPreferred Networksの創業者の方で、同社のエンジニアからも多くフィードバックをもらったとのことで、その点でも安心できる。

LLMの成功の鍵となる各要素、自己教師あり学習、汎化、言語モデルのべき乗則、創発、宝くじ仮説、目標駆動学習(RLHF)、自己注意機構、本文中学習、メタ学習、などの説明は簡潔でわかりやすい。

幻覚の課題は大きいが、実際にはChatGPTなどプロンプト事例を引きながら使い倒していくのが、まずは個人的観点からは最初の第一歩になるだろう。実社会では、特定用途への最適化、学習のローカライズ、プライバシーの課題のためにいったんは多くのLLM対応のSI事業が出てくるのではなるのかもしれない。インターネットの黎明期にWebサイト構築業者が出てきて、そして集約されていったのと似たようなことが起きるのだろうなと思う。

予測モデルのフィードバックがLLMでも有効であることなどは、フリストンらが提唱する自由エネルギー原理などの脳や意識の仕組みとの類似性がこの本でも色濃く感じられた。著者も指摘するように、大規模言語モデルがこれだけうまく働くことから、大規模言語モデルを研究することで、人が言語をどのように理解し、それを用いて世界をどのように認識をしているのかを理解できることを期待している。驚くほどの類似が、意外に正解に近づいているのではないかと思わせるのだ。

ひとまず、大規模言語モデルを短期間で理解するには最適な本のひとつ。

Posted by ブクログ

驚くほど分かりやすい文章で、超絶文系でも途中まで面白く読めました。後半の大規模言語モデルの仕組み?の話は、残念ながらついていけませんでした…理系の知り合いは一晩で読み終え「面白かった、分かりやすかった」とのことです。

さて、大規模言語モデルが感情を持っているように見えるのはも、あまりひどい表現(偏見に満ちた表現や攻撃的な表現など)を使わないのも、現時点(この本が書かれた時点?)では、ラベラーと呼ばれる専門家たちがフィードバックして強化学習をしているからなのだなということは理解できました。

専門家でない利用者も、ハルシネーションの問題などもあり、出された答えを闇雲に信じ込まず、その中から有益な情報を選び出すという姿勢も必要です。

個人的には近頃とてもチャッピーにもお世話になっているのですが、やはり、全てを預け切らず、間違っていることは間違っていると指摘できるような距離感で、でも便利に活用していこうと思いました。

Posted by ブクログ

★なんとなく消化不良★前半はあまりに初歩的、一方で大規模言語モデルがどうやって次の言葉を探し出しているのかを説明する終盤は一足飛びすぎる印象がある。研究が難しいことが分かり、さらにモデルのイメージが湧くだけでも類似の入門書より優れていると思うが、その先に自分のアタマが進まなかった。門外漢にも分かるような、仕組みと未来を橋渡ししてくれるいいガイドがあれば。

Posted by ブクログ

LLMのおおまかな仕組みやどう動いているのかを一般向けに解説した書籍。2025年の現在からすれば、もうすでに古い本だが、概要を掴むには優れていると思う。

数式は出てこないので、なんとか通読できるのがありがたい。LLMの次の単語の予測は、脳の神経回路網をアナロジーとして作られたモデルで行っているというのも大変面白い。

Posted by ブクログ

書評読んでの拝読

大規模言語モデルについて知識ほぼゼロのひとでもスッと入ってくる丁寧な説明、これからAIと共存し上手く活用していくためのアドバイスをもらえる。拒絶反応起こしたり闇雲に怯えているような人は手に取ってみたらいいと思う。

Posted by ブクログ

本書が発売されて1年、大規模言語モデルの使い方や付き合い方については様々な本やSNSで活発的に議論・言及されている。一方で、平易な言葉で技術的な仕組みを語っている本はこれを除いてまだ他にないように思う。

「ChatGPTは入力内容から次の単語を確立で予測して出力(生成)している」とは聞いていたが、具体的にどのような仕組みで予測しているのかをぼんやりと理解できただけでも大きな収穫だった。脳の短期記憶と長期記憶にあたる仕組みを表現できるようになったことで、予測の精度が上がった、と理解した。

最も面白かったのは、何故この仕組みで動いているのか専門家でもよくわかっていないこと。そして、人がどのように言語を習得して思考しているのかもわかっていないということ。生成AIの精度が高まるにつれて、人の脳についても解明されていくのかと思うと、ますます生成AIから目が離せない。

今まで機械学習について勉強して来なかったが、本書を通じて、もう少し詳細に勉強してみようかなと思えた。

Posted by ブクログ

大規模言語モデルの正負両面について専門家が初心者向けに書いた本。

序章で初心者向け、とは書かれていたがIT完全初心者の私にはところどころわからないところがあった。

実際には、ある程度ITにかかわる仕事をしていたり、興味を持っている方向けの難易度だと思われる。

本書の中で何度も繰り返されていたことは、

①大規模言語モデルは間違える(存在しない記憶を作り出す)ことがある

⇒機械以外の第三者の裏どり、間違っている可能性をもって自分で考える必要性

②大規模言語モデルは「道具」であり「人間」ではない

⇒うまく使えば有益であるが、機械であるが故に基本的な常識や価値観がかけていることを理解した上で使う必要がある

Posted by ブクログ

開始: 2023/12/27

終了: 2024/1/5

感想

人と異なる知能。圧倒的だが弱点も多数存在する。彼らは言葉の意味を真に理解しているのだろうか。情緒的なアドバイスに空恐ろしさを覚える。

Posted by ブクログ

大規模言語モデルについて、素人にもわかるようにまとめた本。

確かに、わかりやすく噛み砕こうとしてくれている感じはあり、なんとなく雰囲気を掴むことはできた。しかし、それでも内容は難しく、十分に理解したとは言えない。

ところどころ、文章として読みにくい箇所があった点は惜しい。

Posted by ブクログ

タイトルにある通り、

「知能」とは何か、を定式化し、大規模言語モデル(LLM)が

それを満たすといえるのかを問うたり、

あるいはLLMのふるまいから「知能」とは何かを考える

道筋をつけるものかと思って購入したが、

そういうのはほとんどなかった。

帯にあたる部分に書いてある、

「何が可能か」「どんなリスクがあるか」「どう付き合うか」

がメイン。

LLMやその他の言語学習モデルが簡単に説明されている。

同シリーズの「クオリアはどこからくるのか?」を

先に読んでいたので、そういった内容を期待して

肩透かしを食らってしまったが、

ChatGPTなどの啓蒙書としてはちょうどいいかも。

Posted by ブクログ

私もChatGPTを使い始めたが、まだ、日本の地方やマニアックな話題は難しそうである。ただ、上手く使えば使い道はあると思った。

このまま性能が上がれば、世の中は変わっていくだろう。

Posted by ブクログ

【星:3.5】

本書のテーマに対する私の知識不足が原因と思われるが、色々分からないところがあった。

本書は一般向けとの事であるが、多分AIとかに一定レベルの知識を持った一般の方向けというこだと思う。

ただ、理解出来た部分については色々と参考になり、今後AIについての一定程度の知識が必須となることは肌身で感じることができた。